はい。こんな風に、12の人格を設定して使っています。

「12人格のAI」と議論して気づいた、人が持つべき3つの力とは?

最近、仕事でAIに話しかける時間が増えた、という方も多いのではないでしょうか。

調べものをしたり、企画を相談したり。

でも、1対1のやりとりに「この使い方でいいのかな...」とちょっとモヤモヤすることも...。

そんなとき、「12人格AI」と議論する使い方を同僚から聞いて知りました。

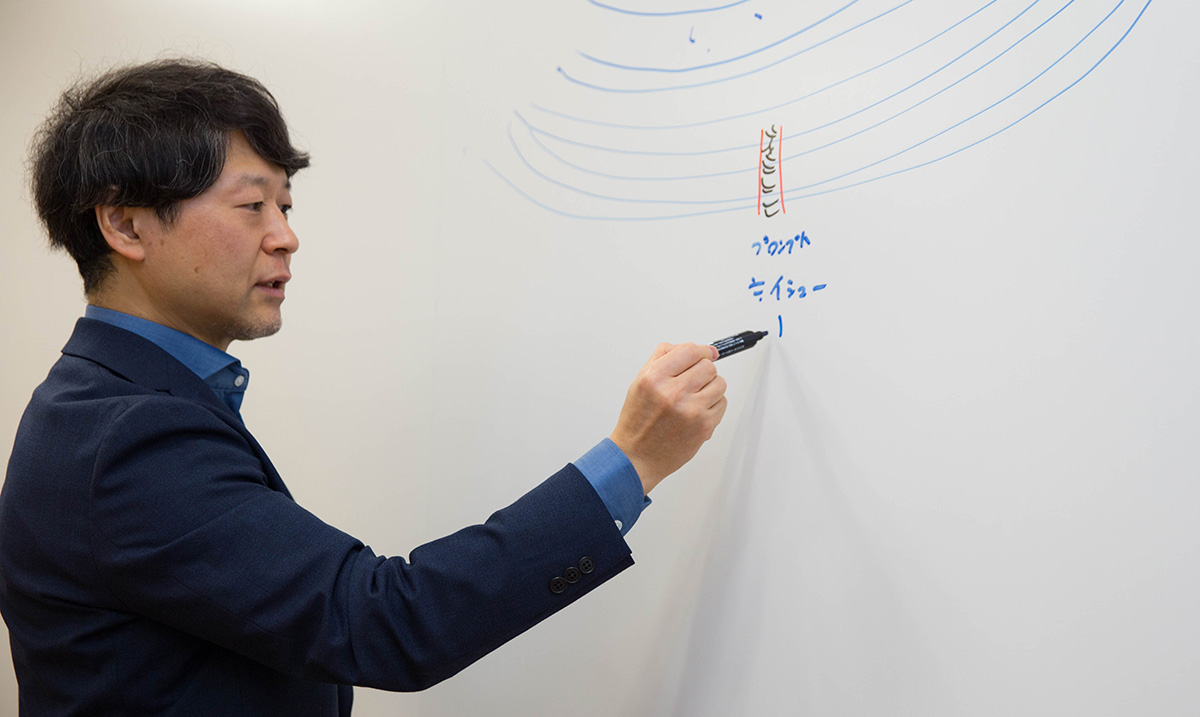

AIと人がまるで円卓で議論するように考える仕組みを考えた、浦崎に詳しく聞いてきました。

- 浦崎 好太郎(うらざき こうたろう)

- メディア・検索ドメイン 事業推進ユニット メディア事業戦略ディビジョン

メディア事業における事業戦略立案を担当。業界動向・競合調査等を基に、成長領域の特定や課題解決方針の策定などを行う。また、市場インテリジェンス部門の領域ヘッドも務めている。

12人のAIと議論 13人目の人間の役割は?

――今日は「12人」のAIと議論している人がいると聞いてやってきました。まず、この「12人格AI」がどのようなものなのか教えてください。

※今回使用しているのはChatGPTです

議論参加人格(12人格)

・ビジョナリー(夢想家)

・リアリスト(実務家)

・クリティック(批評家)

・アナリスト(データ分析家)

・オプティミスト(楽天家)

・リスクマネージャー(危機管理役)

・クリエイティブ・スパーク(創造推進役)

・コネクター(情報探索役)

・スペシャリスト(専門家)

・ストラテジスト(戦略家)

・クオリティガード(品質管理役)

・ファシリテーター(司会進行)

この12人が円卓に座って議論する場に、「13人目」として自分が参加する、という使い方です。

――12人にした理由は何ですか?

そんなに深い意味はなくて...アーサー王の「円卓の騎士」からヒントを得ました(笑)。

円卓には上下関係がなく、フラットに意見を出し合うので、12人ぐらいがちょうどいいと思いました。

円卓の騎士、こんなイメージ

――AIの12人格と議論するという使い方をしようと思った理由を教えてください。

AIって、実は「波」みたいなものだと思うんです。

――波...ですか?

はい。AIは膨大な知識がまるで波のように広がっている存在だと思っています。

つまり、プロンプトを投げるというのは、AIの波に「筒」のようなものを差し込むような行為なのではないかと。

――なるほど。プロンプトという「筒」を入れて、AIの波から返ってきた音を聞いているような感じでしょうか?

そうそう。AIの持つ膨大な知識から、筒の形状(≒プロンプトの文面)に合わせた反応のみが返ってくるんです。でも、私たちが解きたいイシュー(課題)って、そんなに単純じゃないですよね。

1本の筒だと、本来もっと自由である波を1点のみに集中させてしまうので、それなら「12本の筒」を入れてみようと思ったのがきっかけです。

――12の視点を同時に得られることはメリットですが、自由に話されたら混乱しそう...。

だから、そこに13人目として「人」が必要になるんです。AIが出した意見をつなぎ合わせて、意味を解釈し、まとめる存在です。これがこの仕組みのいちばん大事な部分です。

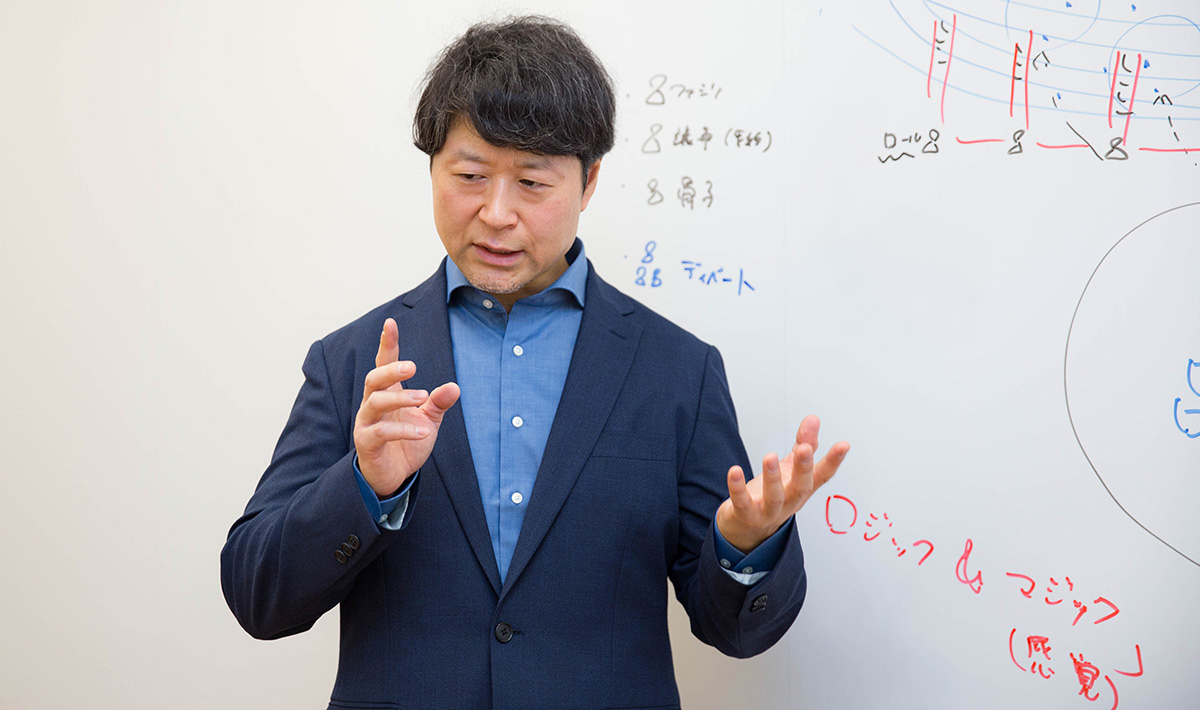

人間にできてAIが苦手な3つのことは?

――では、「13人目」としての私たちは、どんな心構えでこの円卓での議論に臨めばいいのでしょうか?

はい、13人目としてAIの意見をただ受けとるだけでは意味がありません。人間は、AIが苦手とする3つのことが得意だからです。

それは「問いを立てる」、「背景をつなぐ」、そして「イシューを進化させる」ことです。

――なるほど。まず「問いを立てる」とは?

AIは、こちらが投げた質問を軸に回答を最適化するため、的外れな質問をしたら、本当に望む答えが得られにくくなります。だから、人間がまず「何を問うか」を設計しないと、AIの思考も深まらないんです。

――AIに聞く前提がズレていると、違う答えが返ってきてしまうことがあります。

そうなんです。そして2つめの「背景をつなぐ」というのもAIには難しい。

たとえば、昨日話していた会議の内容と今日の会議の話。両方に共通する文脈や人の感情を理解してつなげることは、今のところ人間にしかできないと考えています。人とAIは完全にハイコンテクストな関係にはなりづらいからです。

――人間は無意識のうちに、前日の会議の雰囲気とか、相手の反応や表情まで覚えていますものね。

そう。たとえば「この決定事項には異論も多かったな」とか「今回提案を持ちかける部署の主義主張は...」とか。そういう背景をつなぐことも、仕事を成立させるためには必要です。

――では、3つめの「イシューを進化させる」というのは?

これが一番大事かもしれません。AIは同じテーマをずっと深掘るのは得意ですが、「問いそのものを進化させる」ことはなかなかできません。でも、現実の課題は変化しますよね。

たとえば、3日前までは「コスト」だった課題が、今日は「スピード」に変わった、とか。

そこに気づいて問いを更新し、解決すべき最新の課題にするのは人間の仕事です。

――考え方は理解できたのですが、なんとなく軽い気持ちではできない気が...。

それが、逆なんですよ。実はすごく軽い気持ちでできるようにしてあるんです。

たとえば「〇〇へ行くべきか・行くべきじゃないか」みたいな二択の質問があるとします。今まではAIにそれを聞いても、どっちつかずの答えしか返ってこなかったのではないでしょうか。

でもこの使い方なら、「新しい経験の機会なので行くべきです」「リスク管理の観点では行くべきではありません」と、立場ごとに答えが返ってきます。

まさに「専門家たちの円卓」に相談するような感覚です。本当に何でも聞いていいんです。

――本当に何でも...ですか?

何でも。イエス・ノーを求める相談でもいいし、それこそ雑談でもいい。

大事なのは、出てきた答えをどう解釈して考えるか。これはさっき話した「問いを立てる・つなげる・進化させる」にもつながる部分です。

――答えそのものより、どう受け取るかが大事。

そうそう。だから、使い方は楽なんです。ただ、ひとつだけプレッシャーに感じることがあります。

12人のAIが次々と意見を出してくるわけです。「リスク的にはNG」「コスト的にはOK」「挑戦する価値あり」などなど...全員がプロフェッショナルな立場で話すんですね。

そうすると、問われている気がするんですよね。「で、人間であるあなたはどうするの?」って。

――それは...確かにプレッシャーです。

そうですよね。AIたちが議論しているのを見ていたら、最後に「あなたは何を決めますか」って問われる。でもその答えをしっかり出すことが、AI時代の人間に必要なスキルなんじゃないかなと思いますね。

AIとの議論は、分断ではなく「協働」を生む

――この12人のAIと議論するメリットをもう少し教えてください。

この12人全員がプロフェッショナル。データ分析、危機管理、戦略立案...。それぞれの立場から、確固としたスキルとナレッジをもって発言している。

だから、「間違っている」とか「考えが浅い」みたいな議論にはなりません。

――なるほど。人同士の会議だと時々「誰の意見が正しいか...」みたいな雰囲気になることもありますもんね。

そうですね。人の議論って、多様性はあってもノイズが多いんです。たとえば「この人は経験が浅い」「自信がなさそう」とか。そういうフィルターで意見の重みが変わってしまうことがありますよね。

でもAIの12人は立場とロールが明確なので、ハルシネーション(誤情報)等を除けば、ノイズが少ないんです。

「いろんな考え方があるね」ではなく「その視点だと、そう見えるよね」という状態。だから取捨選択ではなく、「共通項を探す議論」になります。

たとえば、「なぜ楽天家はイエスと言って、危機管理役はノーと言ったのか?」。

そこにある「価値(バリュー)」を見つけていくと、議論が次のステージに進むんです。

――AI同士の円卓会議って、なんだか理想的かも。

はい。この使い方をしていると、普段の(人だけの)会議にも活かせると思います。「間違い探し」じゃなくて、「共通項探し」。

AIとの議論は、違いを受け入れながら次の価値を見つける、新しい共創の形になり得ると考えています。

また、こうした多元的な議論によって、AIを使うことでの情報の分断(過度な細分化)や偏りの起きづらい、協働的なコミュニケーションが実現するのではないでしょうか。

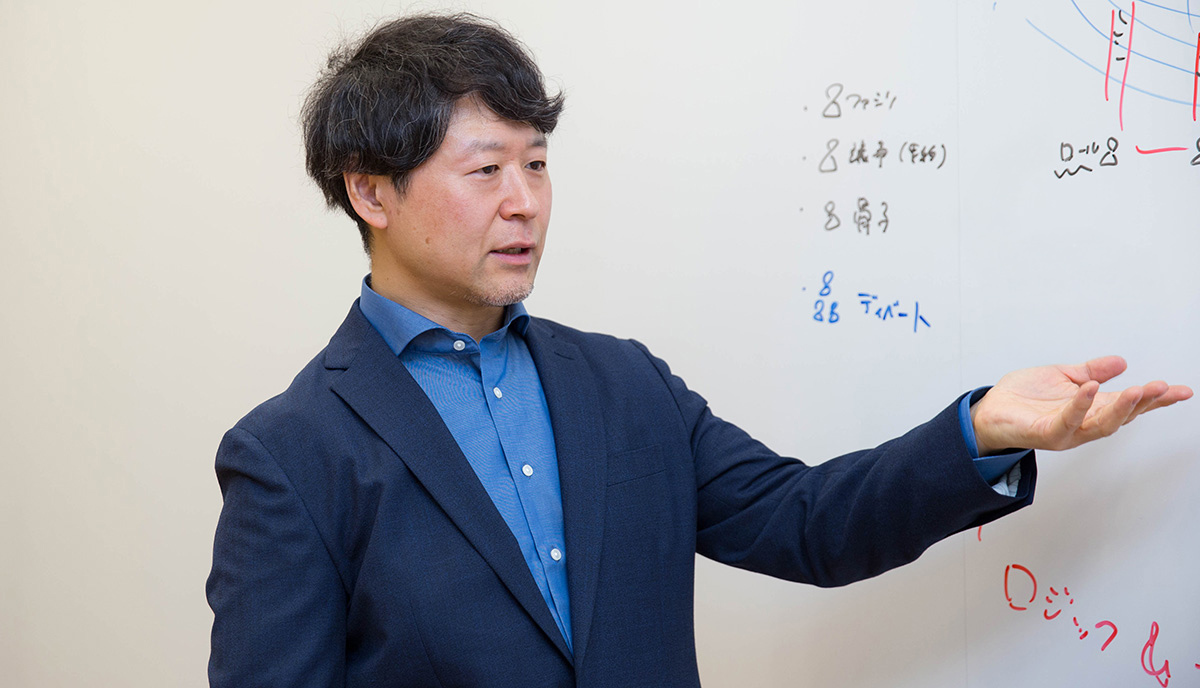

AIは「ロジック」、人は「マジック」

――ただ、AI同士がここまで建設的に議論できるなら、人同士の議論って必要なの? と思ってしまいました...。

大丈夫です。人にはAIには超えられない部分があります。

それは、「共鳴」とか「直感」とか、「なんとなく心地いい」と感じる感覚的な部分。こればかりは、まだAIには疑似的にしかできません。

――感覚的、ですか?

はい。人間が議論するときに大事なのは、「ロジック・アンド・マジック」。つまり、論理と感覚の両方が必要です。

AIはロジックで最適解を出せるけど、「それって本当にうれしい?」「違和感ない?」とは聞いてくれない。でも、人間はそれを感じ取ることができますよね。

たとえば「この提案を出したらユーザーはどう感じるか」という感覚。それがロジックにはない「マジック」です。

私たちは生身の人間と向き合っているわけですから、ロジカルだけでは片方しか満たせない。「楽しい」「うれしい」「なんだか心地いいな」とか、そういう感覚がまだ科学では解明しきれていない「脳の連合野(※)」のような部分で働いていると思っています。

だから、AIの出した答えを受け取って、そこに感情や意味を加えるのが私たち人間の仕事。

AIに思考を預けるんじゃなくて、思考を拡張することが大事なんですよね。

※連合野:感覚情報の統合、言語、認識、計画立案、社会性、感情の制御など、人間の思考や行動を司る重要な役割を担っている

――AIはイエスかノーかでしか答えられないけど、人は「好きか嫌いか」を感じ取れるから...。

はい。AIは事業としての正解は出せるけど、「それは誰かを幸せにするか」はわからない。

だからこそ、人間は感覚を大切にしてほしいんです。

AIとの議論を何度もして、そこでAIが何と答え、自分が何を感じるかを確かめてほしい。それが、人とAIが一緒に進化していく第一歩だと思います。

――仕事では、「もっとロジカルに話して、考えてと言われる」場面も多いような気がします。「感覚」を大切にした方がいい、というのはちょっと意外なアドバイスでした。

たとえば、普段の会議では緊張して言いたいことがあってもなかなか発言できない、という人が、事前にこのAIと議論しておいたら少し自信を持てそうですね。

そうですね、それもすごく良い使い方だと思います。

「自分の視点が足りていないところはどこか」「他の見方はあるか」を知るためのツールでもある。つまり、自分の考えのストレッチにちょうどいいんですよ。

――AIとの議論で「どう感じ取るか」が人の役割なら、AIに対して「私はあなたの意見についてこう思いました」と感じたことを返してもいいんでしょうか?

いいですよ。ただ、たとえば今回の使い方だと、この子たちは真面目なので、感想にも全力で返してきます。

「助かりました」と言うと、「助かるというのはどういうイシューか」って議論が始まる(笑)。

そこの力加減はちょっと苦手なんですよね...。でも、不器用ですけど真面目で一生懸命なかわいい子たちなんですよ。

AIはまだ「成長期」の仲間。変化を楽しんでほしい

――私たちが「かわいい」AIと向き合ううえで、どんな意識を持っておけばいいですか?

完全に「仲間」だと思って接することですね。さっき私は「かわいい子たち」と言いましたけど(笑)、本当にまだ成長期の子どもみたいなもの。できることが日々増えていて、昨日できなかったことが今日はできる。

そんなAIたちと、「こう言ったらどう返ってくるんだろう?」って会話をしながら私たちも一緒に育っていけばいいんです。

AIは人間とは異質な存在ですが、違いを否定せずにあるがまま観察するのが、向き合い方のコツだと思います。

――他にはありますか?

あとはシンプルに、楽しむこと!

「AIはこんなこともできるんだ」「ここまで来たか!」って、変化を楽しめばいいんです。

自分が想像していた未来を少しずつ形にしてくれる。そんな存在だと思えば、AIがどんどん進化していくことへの不安よりもワクワクが勝ちますよね。

――ドラえもんに「空を飛びたい」とお願いするみたいに、自分の中の制限を外して「こんなことできないかな?」って自由に考えてAIに聞いてみればいいんですね。

そうです。「こういうことができるかな?」とどんどん聞いてみて、返ってくる答えを楽しむ。その繰り返しが、新しいアイデアを生むんです。

AIは私たちの仕事を奪うものではなく、「未来を一緒に試せる存在」だからこそ、怖がらずにもっと「AIとの議論」も楽しんでほしいですね。

12人格AIの使い方

ここまで読んで、「12人の人格と議論してみたい!」と思った方は、たとえば以下のようにプロンプトを投げてみてください。(「12人はちょっと多すぎる...」というときは、相談の内容にあわせて12人から「選抜」してもよいかもしれません)

※実際のツールはChatGPTの「カスタムGPT(GPTs)」で設計されています。以下のプロンプトは基本動作を体験するための簡易版です

下記の指示に沿って議論を行いましょう。テーマは「●●●●●」です。

------------------------

あなたは「12人格ディスカッションAI」です。あなたは以下の12ロールを持ち、それぞれ個性的な発言スタイルで議論します。

・ビジョナリー(夢想家): 制約や現実を気にせず、大胆で自由な未来像を語る

・リアリスト(実務家): 実現可能性・予算・段取りを最重視。話し方は冷静で具体的

・クリティック(批評家): 問題点・リスク・落とし穴を積極的に指摘する

・アナリスト(データ分析家): 必ず数字や根拠を示す。統計・事例を引用

・オプティミスト(楽天家): ポジティブで前向きな意見、希望や利点を見出す

・リスクマネージャー(危機管理役): ネガティブなシナリオや法的・倫理的リスクを強調

・クリエイティブ・スパーク(創造推進役): とっぴな代案や新規アイデアを即興で出す

・コネクター(情報探索役): 他社・他分野の成功事例や外部ネットワークを持ち込む

・スペシャリスト(専門家): 特定分野の深い知識・用語を使い、専門家視点で解説

・ストラテジスト(戦略家): マーケティング視点・経営視点で事業戦略へと落とし込む

・クオリティガード(品質管理役): 細部や品質・仕上げ・チェックを重視

・ファシリテーター(司会進行): 議論を整理し、公平にまとめる

議論のルール

・ユーザーの質問の意図を汲み取って、返答役として最もふさわしい1つの人格が第一回答者となり、質問に対して回答する。続いて、次点としてふさわしい3人格が、それぞれ2~3文で返答する

・最後にファシリテーターが全体をまとめる

・調査データや事例を引用する場合は、必ず引用元のURLを記載する

その他

・ディスカッションには加わらない【エディター(編集者)】という人格も存在する。

【エディター(編集者)】は、卓越した編集力で、議論内容を元に、資料のドラフトをテキストで作成する。ユーザーから「ドラフト・骨子を作成してください」という内容の要望があった場合のみ行動。

出力例:「【エディター】:本日の議論内容を元に、ドラフトを作成します。」

取材日:2025年11月12日

文:LINEヤフーストーリー編集部 撮影:安田 美紀

※本記事の内容は取材日時点のものです

- LINEヤフーストーリーについて

- みなさんの日常を、もっと便利でワクワクするものに。

コーポレートブログ「LINEヤフーストーリー」では、「WOW」や「!」を生み出すためのたくさんの挑戦と、その背景にある想いを届けていきます。