責任あるAIへの取り組み

LINEヤフーは、ユーザープライバシーの保護と適切な情報管理を徹底し、AI倫理基本方針に基づき様々なAIをサービスや開発に広く活用しています。特に生成AIについては、日本で最も活用している会社を目指し、従業員が活用するための技術基盤や利用環境の構築・整備を行っています。LINEヤフーは、生成AI活用による業務効率化や、より利便性の高いサービスのユーザー提供等を通じて、中長期的に収益の拡大を目指します。

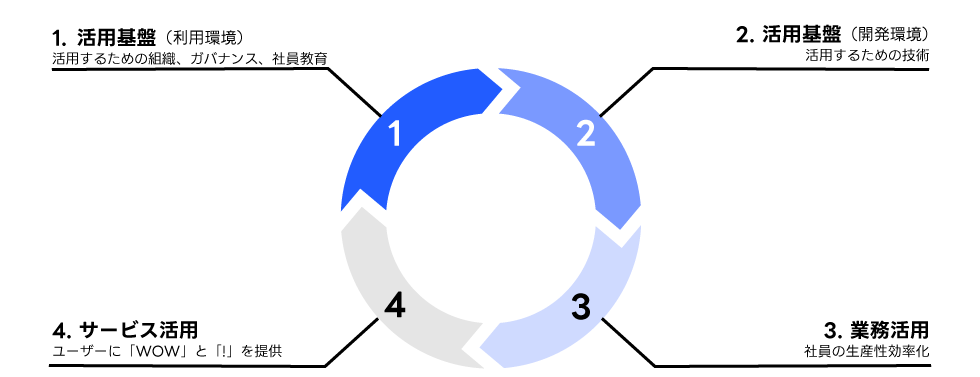

生成AI活用推進サイクル

LINEヤフーは、強みである豊富な日本のデータと多数の日本ユーザーとの接点を活かし、生成AI活用推進サイクルを回すことができる”超実践的”な環境を整備しています。

生成AI活用推進サイクル図

1.活用基盤(利用環境)の整備

LINEヤフーは、ユーザーのプライバシーを保護しながらAIを安全に活用するための方針として、AI倫理基本方針をはじめとしたガイドライン・ルールを整備しています。詳細は「責任あるAI」をご覧ください。

2.活用基盤(開発環境)の構築

LINEヤフーでは、最適なパートナーと提携するマルチベンダー戦略を採用しており、生成AIを活用するための技術基盤として、従業員が様々な生成AIを選択できる環境づくりに取り組んでいます。OpenAIやGoogle等、複数のAI開発企業から提供される大規模言語モデルも利用可能としています。

3.業務活用の推進

全役職員※に対して、生成AIのリスクやプロンプト作成の工夫に関する研修を必須とし、基本的な知識とリテラシーを身に付けたうえで、社内専用の対話型AIアシスタントや2025年6月より「ChatGPT Enterprise」を利用しています。これらの取り組みにより、多様な生成AIを安全に利用できる環境を整備し、生産性の向上を図っています。

※役員・正社員・嘱託社員・契約社員・派遣社員・アルバイト社員・業務委託社員

4.サービス活用

LINEヤフーでは、生成AIを利用した様々な機能をLINE、Yahoo! JAPANをはじめとしたサービスにて提供しています。詳細は「サービスにおける生成AI利活用」をご覧ください。

関連リンク

責任あるAI

AIガバナンス確立に向けた取り組み

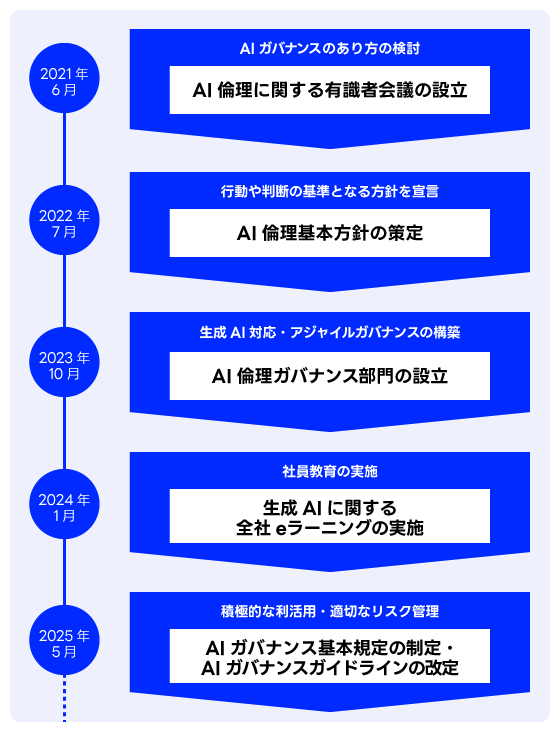

LINEヤフーは、2021年6月に「AI倫理に関する有識者会議」を設置し、社会のニーズをふまえたAI活用のあり方、特にその倫理的側面について継続的に外部の専門家と議論を重ねています。2022年7月、ユーザーのプライバシーを保護しながらAIを安全に活用するための方針として、取締役会決議のもとAI倫理基本方針を策定しました。

2023年10月には、AI倫理基本方針に基づく実効的なAIガバナンスを実現するため、AI倫理ガバナンス部門を創設しました。

2025年5月には、AI倫理基本方針で示される理念に基づき、AIガバナンスに関する体制、責務などを定めたAIガバナンス基本規程を制定しました。本規程では、AIガバナンス責任者を設置し、AIガバナンス責任者は社長が指名するものとし、また、AIガバナンス責任者、役職員、組織それぞれの責務を明確にしました。

あわせて同月には、生成AI技術の急速な発展に対応し、AIガバナンスガイドラインを刷新しました。積極的なAI利活用を促進すると同時に、最新の技術動向に適応したリスク管理の在り方についても、推奨事項を詳細にまとめています。

AI倫理基本方針は次の8項目を定めています。

- 情報の多様性から生まれるより良い未来の創造と人類への貢献

- 平和で持続可能な社会の実現

- ガバナンスコントロール

- 公平性と公正性の追求

- 透明性と説明可能性の追求

- 安全性とセキュリティの確保

- プライバシーの保護

- AI人材の育成

これらを実効的に遵守するため、次のような取り組みを行っています。

- マルチステークホルダーによるガバナンス体制

- セキュリティ確保・プライバシー保護の取り組み

- AI利活用におけるリスク評価と対応

- 社員教育

- アジャイルなガバナンス施策

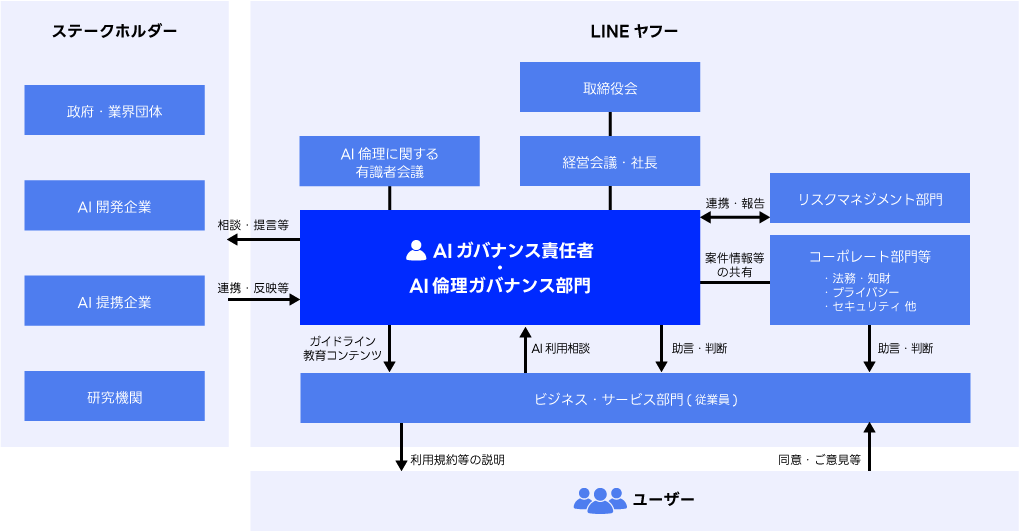

マルチステークホルダーによるガバナンス体制

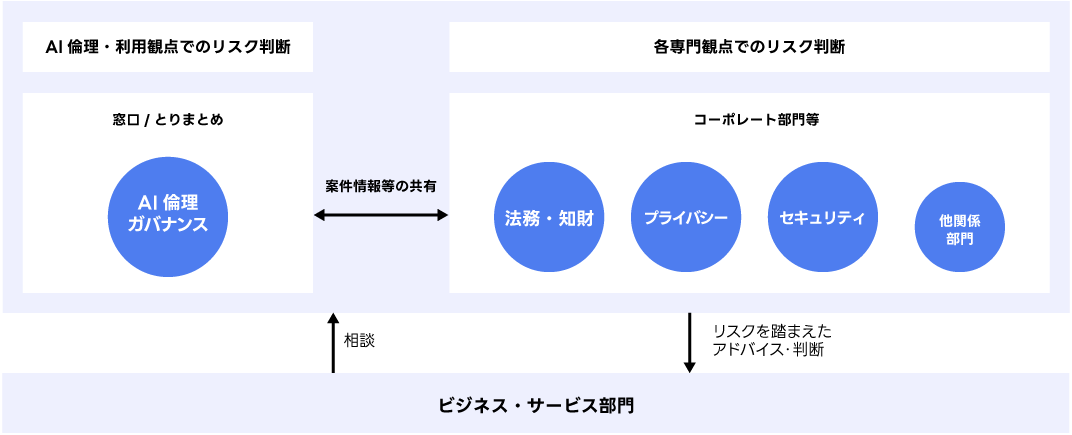

AIの利活用に伴うリスクは、技術的な安全性や法的適合性に関するものにとどまらず、プライバシーや公平性の問題など多岐にわたるのが特徴です。リスク評価にあたっては、その時々の社会的受容性にも十分配慮する必要があります。

LINEヤフーでは、こうした複雑かつ多面的なリスクに適切に対応するため、社内外の多様なステークホルダーが関与するガバナンス体制を構築しています。

社内では、AI倫理ガバナンス部門を中心に、利活用の内容やリスクの性質に応じて、必要な専門知見をもつ関係者が柔軟に関与する体制を整備しています。これにより、複雑かつ多面的なリスクを踏まえ、バランスの取れた統合的な判断が可能となるようにしています。

また、AIガバナンスに関する重大な決定については、「AI倫理に関する有識者会議」での専門家の意見を踏まえて判断しています。さらに、国内外の政策動向や社会的議論、ユーザーの意見など、多様な立場の声を幅広く参照しながら、透明性と主体性をもって、協調的で健全なガバナンスの形成を目指します。

以上の包括的な取り組みにより、AI利活用に伴う問題を未然に防ぐための体制を整え、ユーザーが安全・安心に利用できるサービスを提供しています。

関連リンク

セキュリティ確保・プライバシー保護の取り組み

ユーザーの皆さまの安全・安心を最優先に考え、当社では従来よりセキュリティやプライバシーに関する最善の取り組みを実施しています。

AI利活用に不可欠なデータの取り扱いについても、「データプロテクション基本方針」および「サイバーセキュリティ基本方針」に則り適切に運用しています。

これらの取り組みに加え、AIシステムに特有の課題に対しても、AI倫理ガバナンス部門やセキュリティ部門をはじめとする部署横断的かつ継続的な取り組みを通じて、安全で信頼性の高いAIサービスの提供に努めています。

これからも、私たちは技術革新と安全性の両立を目指し、皆さまに安心してご利用いただけるサービスの提供を続けてまいります。

関連リンク

AI利活用におけるリスク評価と対応

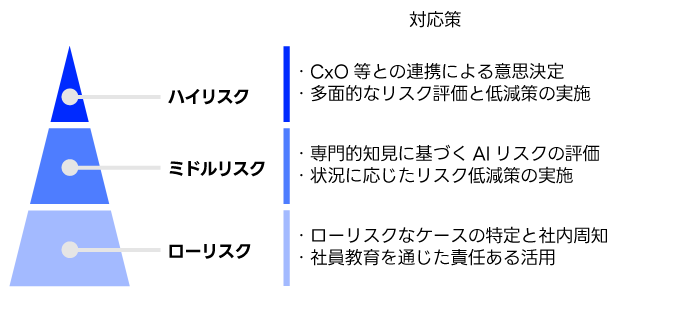

リスクベースアプローチによる「ガバナンス」と「イノベーション」の両立

当社では、AI利活用に際し、リスクベースアプローチに基づき、倫理的・法的・社会的な観点から潜在的なリスクを適切に評価し、その大きさに応じた対応策を策定・実行しています。

具体的には、リスクの程度に応じて、支援内容や関与の方法を柔軟に調整できる体制を整備しています。

リスクが高いと判断される場合には、AI倫理ガバナンス部門を中心に、CDOやCISOなどのCxO、および横断的なコミッティと連携し、意思決定を行っています。

中程度のリスクについては、専門的知見に基づく助言やリスク低減支援を通じて、適切な対応を実施しています。

上記に該当しないような、リスクが低いユースケースについても、あらかじめ該当する条件を明確に定めたうえで、受講必須の教育コンテンツを通じて習得したAIリスクに関する基礎的な理解を踏まえ、従業員一人ひとりが自律的に適切な対応を実施できるようにしています。

このような枠組みにより、現場の創意工夫によるイノベーションを促進しつつ、責任あるAI利活用を全社的に推進しています。

AI倫理基本方針に基づくAIリスク評価

当社では、AIの利活用に伴うリスクを適切に把握・評価するため、AI倫理ガバナンス部門がAI倫理基本方針に基づいて代表的なAIリスク領域を特定しています(2025年5月時点)。

代表的なAIリスク領域:

- 情報の多様性の尊重

- 適切な品質管理

- 知的財産権への配慮

- 誤用・悪用の防止

- 過度な依存の防止

- 適切な外部連携

- 公平性の追求

- 公正市場への配慮

- AIシステムへの攻撃からの保護

- AIシステムにおけるプライバシー保護

これらのAI特有の観点に加えて、コンプライアンス、透明性などを含む包括的な分析を行っています。社内や自社プロダクトでAIを活用する際は、法務、プライバシー、セキュリティ、知財などの各部門が連携し、専門的な視点からリスク評価を実施したうえで、総合的な判断に基づき活用可否を決定しています。

こうしたAIリスク評価の観点は、社内における「AIガバナンスガイドライン」に明記されており、社員が自主自律的にAIを利活用できるよう、判断基準や留意事項を平易に整理・共有しています。これにより、現場主導の取り組みにおいても、一人ひとりの行動レベルで、責任あるAI利活用の実現を目指します。

このように、AIに固有のリスクと、従来の情報システムが抱える一般的なリスクの両面から多角的な評価を行うことで、責任あるAI利活用の実現と継続的なリスクマネジメントを支えています。

AI倫理ガバナンス部門を中心としたチェック体制

社員教育

LINEヤフーでは、生成AIの利用に伴うリスク(情報漏えい、権利侵害、プライバシー侵害、ハルシネーションなど)に対する意識を高め、リスクの顕在化を未然に防止する判断や行動を促すため、全役職員※に必須の研修を実施しています。この研修はeラーニングとテストで構成され、 生成AIの出力品質を向上させるためのプロンプトの工夫についても学びます。研修内容は、社会情勢 やAI技術の進展に応じて適宜見直され、全役職員は、概ね半年に一度研修を受講しています。

※役員・正社員・嘱託社員・契約社員・派遣社員・アルバイト社員・業務委託社員

- 2024年度上半期受講率:97%

| 主要リスクの学習 | 情報漏えい、権利侵害、不正確な出力、差別的な出力、プライバシー |

|---|---|

| プロンプトの学習 | 出力品質の向上(プロンプトの良い例・悪い例、テンプレートの提示) |

2025年度は、積極的なAI利活用を進めるためさらに、生成AIを活用したサービス提供や、生成AIを使って作成した情報発信を実施・検討中の社員を対象に、生成AIを業務利用する際のリスクとその低減策、影響を及ぼす可能性のある海外法規制の概要等についての研修も実施しています。

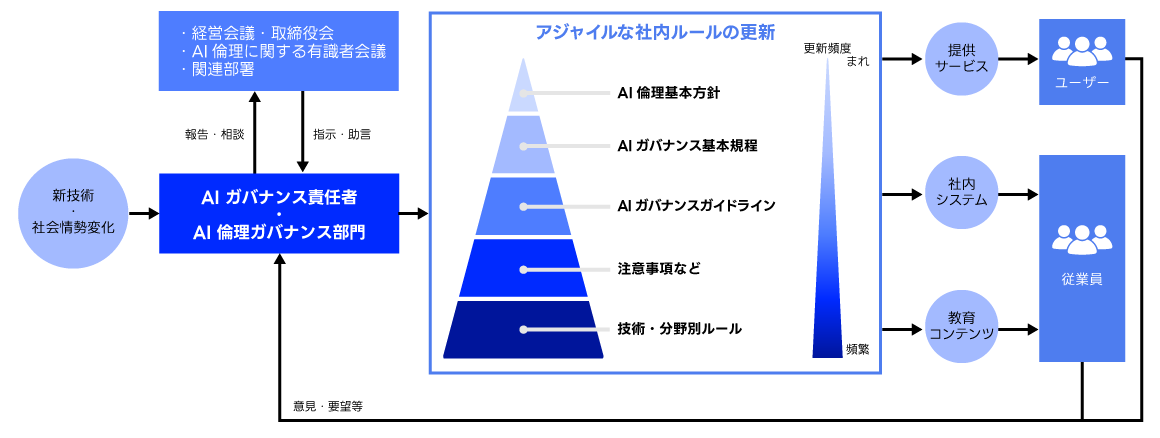

アジャイルなガバナンス施策

昨今、生成AIを中心としたAI技術は急速な発展を遂げ、大手テクノロジー企業や新興事業者の躍進、さらには国内外での法規制整備の進展など、取り巻く環境は刻々と変化しています。

このような状況下で、LINEヤフーは画一的な運用にとらわれず、環境の変化に対応できる柔軟なガバナンスの仕組みを構築しています。

新技術が登場した際や、法規制や社会情勢の変化が起きた際には、AI倫理ガバナンス部門が主導し、関係部署やプロダクト開発チームと密に連携しながら、様々なガバナンス施策を迅速に実施できる体制を整えています。

当社は、AI を取り巻くめまぐるしい変化に即応するため、ガイドライン等の社内規範を固定的な文書としてではなく、不断の見直しと更新を前提とするアジャイルな運用を採用しています。社内からのフィードバックや実務上の課題、外部有識者の助言を踏まえ、必要に応じて速やかに改定を行い、全社的に共有しています。

また、生成 AI を利用した提供サービスや社内システムは、最新の技術や社会情勢を反映した社内ルールに則って開発・運用されています。さらに、教育コンテンツにも最新動向を織り込み、従業員一人ひとりの知識と倫理観を継続的にアップデートしています。

このように、当社は技術革新と社会的要請の両方に機動的に対応するガバナンスの仕組みを通じて、AI利活用の積極的な推進と責任の両立を実現しています。

サービスにおける生成AI利活用

LINEヤフーでは、生成AIを利用した様々な機能を「LINE」、「Yahoo! JAPAN」をはじめとしたサービスにて提供しています。

LINEアプリでの活用

コミュニケーションアプリ「LINE」では、OpenAIのAPIなどを利用し、友だちと話すように質問や、情報収集、画像生成が無料でできる「LINE AI」を提供しています。「LINE」はユーザーと生成AIをつなぐことで、より豊かなコミュニケーションを実現し、さらに便利なコミュニケーションアプリへと進化します。

関連リンク

コマースサービスでの活用

「Yahoo!ショッピング」にて、生成AIとチャット形式で対話しながら最適な商品を探せ、生成AIがユーザーの意図などをくみ取りながら検討から購入後まで買い物全体をサポートするエージェント型の新機能や、「Yahoo!フリマ」で、写真を撮るだけでAIが相場価格を算出する「らくらくAI査定」の提供を開始するなど、AIを活用し、ユーザーがより便利に、おトクにお買い物できる機能を積極的に提供しています。

関連リンク

メディア・検索サービスでの活用

「Yahoo! JAPAN」や「Yahoo!検索」などのメディア・検索サービスでは、ユーザーの多様なニーズをもとに、生成AIを活用して利便性を向上する機能を提供しています。

関連リンク

違反投稿の監視での活用

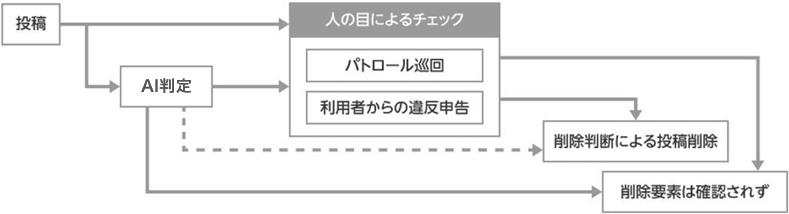

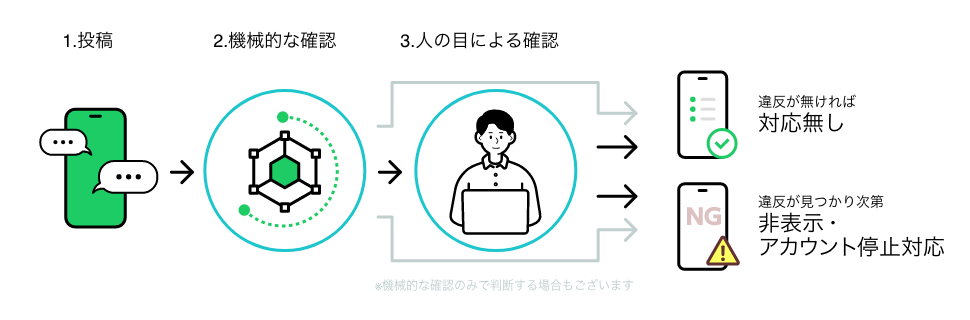

LINEヤフーでは、ユーザーの表現の自由に配慮しつつ、AIと専門チームによる「人の目」を組み合わせて、違反投稿の監視を行っています。

Yahoo!知恵袋・Yahoo!ファイナンス掲示板・Yahoo!ニュース コメント

独自に開発したディープラーニング特化のスーパーコンピューター等を活用した機械学習システムを導入し、禁止行為に抵触する投稿を迅速に探知できる仕組みを構築しています。具体的な活用方法はサービスによって異なりますが、機械学習システムにより投稿が禁止事項に抵触する内容である確率を判定し、抵触の可能性がある場合、自動削除や専門チームによる優先的な確認を行っています。

LINEオープンチャット・LINE VOOM(パトロール・システム)

ユーザーによるテキスト、画像や動画などの投稿について、投稿ガイドライン違反のリスク判定を自動的に行うAIを利用しています。サービスに最適化された違反投稿探知システムで、ユーザーの投稿を適切に確認できる環境を実現しています。

2024年度 投稿件数

| Yahoo!知恵袋 | 66,199,309件 |

| Yahoo!ファイナンス | 29,415,652件 |

| Yahoo!ニュース コメント | 113,995,832件 |

| LINEオープンチャット | 5,514,828,787件 |

| LINE VOOM | 403,331,897件 |

| ※自動削除や人の目による削除判断補助などにAI等を利用 | |

関連リンク

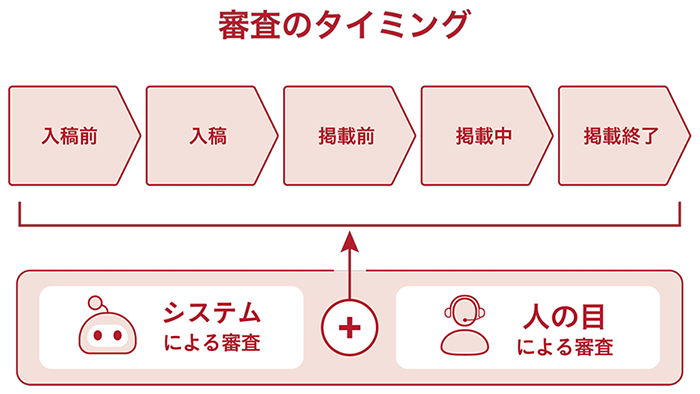

広告審査における活用

AIを活用した「システム」および「人の目」により、24時間365日、広告審査を実施し、ユーザーの意図に合った有益な広告を迅速に掲載することを目指しています。

2024年度 Yahoo!広告 非承認件数

| アカウント | 10,364件 |

| 広告素材 | 197,910,220件 |

関連リンク

LINE公式アカウントのモニタリングでの活用

問題のあるコンテンツを迅速かつ確実に検知・除去するため、AIを活用した「システム」や「人の目」による確認を、24時間365日実施しています。

2024年下半期 アカウント停止数・コンテンツ非表示数

| アカウント停止数 | 137,813件 |

| コンテンツ非表示数 | 27,626件 |

関連リンク

生成 AI 利用に伴う GHG 排出削減に関する取り組み

生成 AI や先進技術の利用が拡大するなか、データ処理量が急増し新たな温室効果ガス(GHG)排出のリスクも高まっています。この課題に対し、LINE ヤフーグループはAI倫理基本方針で掲げている通り「平和で持続可能な社会の実現」 に向けて、追加性のある再生可能エネルギー由来の電力調達等によって、事業活動におけるスコープ 1(直接排出)およびスコープ 2(間接排出)の温室効果ガスを 2030 年度までに実質ゼロにする「カーボンニュートラル」の達成を目指しています。さらに取引先等サプライチェーン関連のスコープ 3(その他の間接排出)を含めた全体の排出量を 2050 年度までに実質ゼロにする「ネットゼロ」を目指しています。